近期,MILab在弱监督图像分割方面取得新进展,相关研究论文“Background-Aware Classification Activation Map for Weakly Supervised Object Localization”已被人工智能领域顶级期刊IEEE Transactions on Pattern Analysis and Machine Intelligence 在线发表。

图像定位及分割可以场景理解及疾病诊断提供重要的目标或病灶位置信息,一直以来是计算机视觉及医学影像处理中的研究热点。然而图像定位或分割模型的训练依赖于大量逐像素的密集人工标注,这一标注过程极大的耗费了时间及人力,增加了视觉从业人员及医生的工作量。为减轻标注工作的负担,弱监督图像定位方法在训练过程中利用图像级标签(如图像类别)替代像素级标注作为图像级特征的监督信号训练图像分类模型,并在测试过程中将该分类模型的分类头作用于像素级特征得到分割或定位结果。然而在图像分类模型于图像分割模型的具有任务差异性,即图像分类模型仅需鉴别图像中前景物体的类别而分割模型不仅需要鉴别像素是否属于前景物体还需判定该像素是否属于背景。因此,仅依赖于前景分类任务训练的图像分类模型会在背景区域产生噪声激活,同时需要依赖人工选取的背景阈值来滤除背景像素以得到物体定位图。

为解决上述问题,MILab研究团队提出了B-CAM框架用以在分类模型训练的过程中引入额外的背景分类任务,从而解决分类模型与分割模型的任务差异性,使得依据图像级标签训练的分类模型可以同时生成前景定位图及背景定位图以最终决定定位/分割伪标签,用以更好的辅助后续分割模型训练。在B-CAM框架中,MEA模块使用两个Attention Pooling操作代替CAM中所使用的Global Average Pooling以提纯图像级特征得到更为纯净的图像级特征前景z^o与图像级背景特征z^b。随后,我们以二者同时输入至前景分类器及背景分类器,以同时输出两个提纯图像级特征的前景及背景分类概率,并以多任务学习的方式训练。这样一来在测试过程中,我们即可使用这两个分类器同时生成前景定位图与背景定位图进而得到最终定位结果。

图1-传统弱监督定位框架与B-CAM框架对比;B-CAM可以提纯图像级特征并训练额外的背景分类器辅助物体定位。

图1-传统弱监督定位框架与B-CAM框架对比;B-CAM可以提纯图像级特征并训练额外的背景分类器辅助物体定位。

由于在图像分类问题中并不存在纯背景图像,因此为保证B-CAM框架可以有效训练背景分类器,我们还提出了一套背景监督信号导出策略。具体来说,我们认为背景图像级特征z^b可以近似的看作从纯背景图像的图像级特征,因此该特征为所有物体的背景;而对于前景图像级特征z^o,由于其中仅可能包含该图像分类标签中所含样本,因此该特征可以看作除该图像的图像级标签外,所有其他物体的背景。依据该策略,我们即可有效训练出类别敏感的背景分类器,来辅助前景分类器进行背景区域预测。此外,我们还利用背景级图像特征z^b抑制前景分类器的背景响应,以减少背景区域的错误激活。

图2-整体模型结构及监督信号的导出策略

图2-整体模型结构及监督信号的导出策略

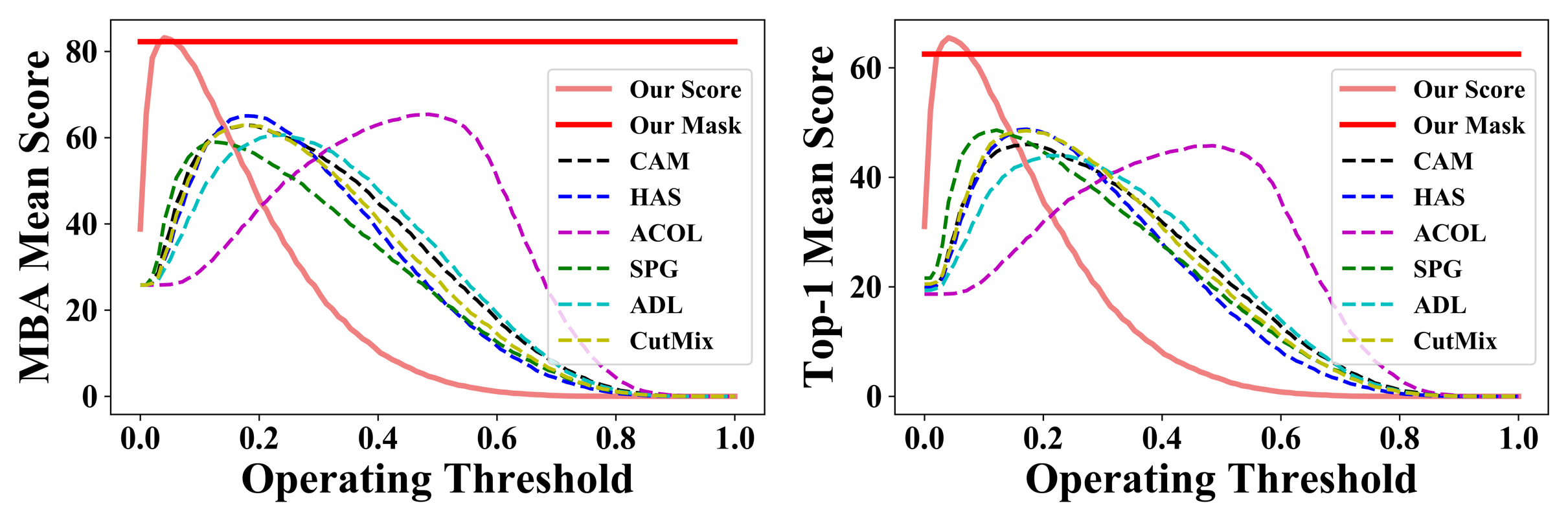

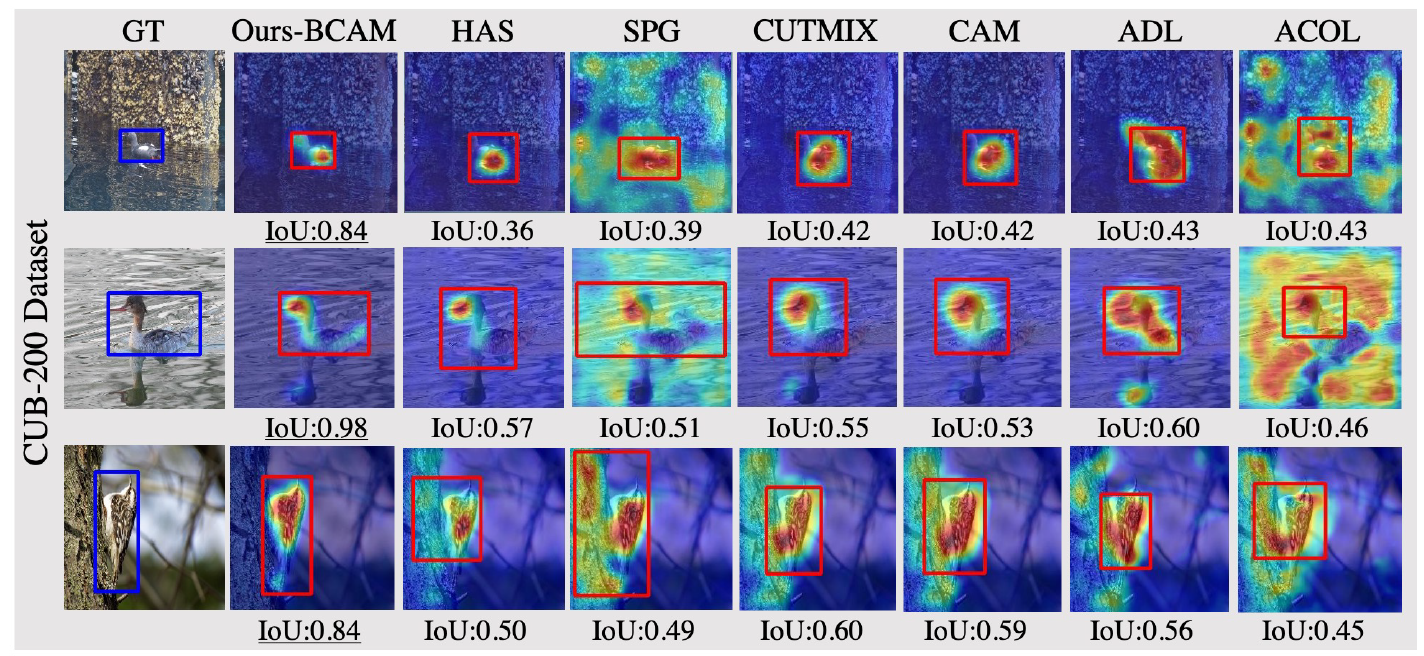

我们在四个标准弱监督定位/分割数据集上对我们的方法进行了验证,包括CUB-200鸟类细粒度识别数据集,OpenImages分割数据集以及ImageNet目标识别定位数据集及VOC-2012弱监督分割数据集,可以看到我们的方法不仅可以有效抑制前景分类图的背景响应从而提升弱监督定位上界,还可以通过背景分类器生成像素级的背景定位图以避免人工搜索图像级背景阈值。

图3-本方法与其他弱监督方法在不同背景阈值下的性能比较

图3-本方法与其他弱监督方法在最优背景阈值下的弱监督定位效果

该论文的第一作者是MILab博士生朱磊,通讯作者是卢闫晔助理教授。该研究得到了国家自然科学基金(82371112)、北京市自然科学基金重点项目(Z210008)、青年学者科技创新启航计划(BMU2023YFJHMX007)、深圳科技计划(KQTD20180412181221912, JCYJ20200109140603831)、国家生物医学成像大设施基金的经费支持。

文章链接:https://ieeexplore.ieee.org/abstract/document/10234096

相关代码已开源: Code-GitHub

添加评论